DeepMind兩機械人 完美執行現實任務

原文刊於信報財經新聞「CEO AI⎹ EJ Tech」

當機械人結合人工智能(AI),能協助人類執行體力任務,例如處理家務等工作。谷歌(Google)旗下AI部門DeepMind在周三(12日)介紹兩種新AI模型Gemini Robotics及Gemini Robotics-ER,為新一代輔助機械人奠定基礎。為了對人類有幫助,谷歌認為機械人的AI模型需要具備3個主要特質,分別是通用性、互動性及靈巧性,在現實世界應付更廣泛任務。

以Gemini 2.0為基礎

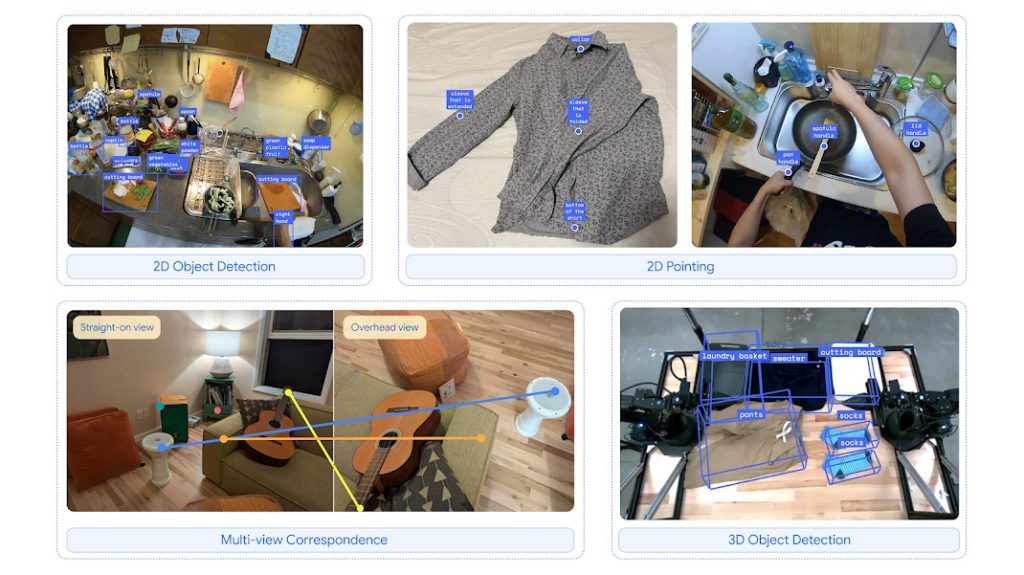

Gemini Robotics以Gemini 2.0大型語言模型為基礎,整合「視覺、語言、動作」(VLA)能力。即使事前未經訓練,機械人亦能處理視覺資訊、理解語言指令,執行更精確的物理任務,例如摺紙或把零食放入密實袋。另一款Gemini Robotics-ER,屬於先進視覺語言模型。ER即是「具身推理」縮寫,具有先進空間理解能力,包括偵測並指向物體部分、尋找對應點及偵測3D物體。例如展示咖啡杯時,AI模型可直觀地知道,可用兩根手指捉住杯柄,以及靠近杯子的安全軌跡。

谷歌與美國得州科企Apptronik合作,把Gemini機械人的AI模型,作為後者Apollo人形機械人的「大腦」,同時向Agile Robots、Agility Robots、Boston Dynamics及Enchanted Tools等科企,供值得信賴的測試人員使用。受到科幻小說家艾西莫夫(Isaac Asimov)筆下《機械人三定律》(Three Laws of Robotics)啟發,DeepMind去年推出「機械人憲法」(Robot Constitution)框架,並發布一個ASIMOV數據集,讓研究人員評估機械人的動作安全。

與此同時,谷歌同場加映輕量級開放模型Gemma 3,可以輕鬆分析圖片、文字、短影片等應用,設有10億(1B)、40億(4B)、120億(12B)及270億(27B)4種參數規格,標榜可在單一圖像處理器(GPU)或張量處理器(TPU)運行。模型上下文窗口可輸入12.8萬Tokens,在LMArena基準測試的表現,超越Llama-405B、DeepSeek-V3及o3-mini,經過預訓練可增至超過140種語言。用戶可在Google AI Studio試用Gemma 3,亦可在Kaggle或Hugging Face平台下載模型。

推Gemma 3可分析圖像答問

日常應用方面,Gemma 3可分析圖像解答問題,例如上傳一張冷氣遙控器相片,再問AI模型:「我需要暖和起來,哪個按鈕可調高溫度?」之後AI就會回答「最有可能調高溫度的按鈕是暖房(Danbou),帶有加號(+)的按鈕或會調節溫度。此外,谷歌開發人員在Gemma 3模型的基礎上,構建40億參數的影像安全檢查器ShieldGemma 2,針對危險內容、露骨色情、暴力三種分類設下安全標籤。

支持EJ Tech

如欲投稿、報料,發布新聞稿或採訪通知,按這裏聯絡我們。

如欲投稿、報料,發布新聞稿或採訪通知,按這裏聯絡我們。