腦機介面|腦機介面解碼 助癱者「說話」

原文刊於信報財經新聞「CEO AI⎹ EJ Tech——前沿科技」

美國加州大學柏克萊與三藩市分校的研究團隊,日前在學術期刊《自然神經科學》發表論文,表示已成功開發和優化一種創新的腦機介面技術,讓一位因腦幹中風導致癱瘓、失去語言能力長達18年的女性,藉腦波即時合成語音與文字重新「說話」。

微電極捕捉腦訊號轉語音

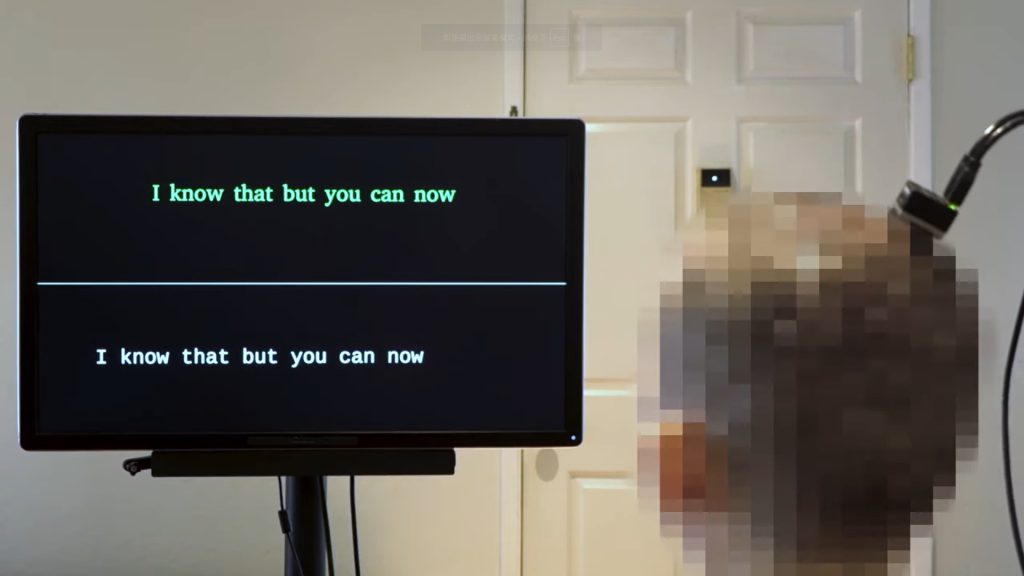

研究團隊於這位47歲女性的大腦語言區,植入了253個微型電極,捕捉她試圖「說話」時的大腦訊號。系統透過人工智能(AI)解讀這些訊號,利用循環神經網絡變換器(RNN-T)解碼,轉換為語音和文字,再由電腦喇叭發出聲音,並在熒幕顯示文字。這項技術稱作「即時串流式腦語音神經義體」。

示範影片可見,整個系統可在每80毫秒更新一次輸出,幾乎能跟自然講話同步。參與者「說話」速度平均為每分鐘47到91個詞,接近一般人正常語速。此外,語音延遲中位數約為1.12秒,遠勝原本輔具所需的平均23秒。模型幾乎不會誤判輸出語音,連續使用時間長達近6分鐘,僅出現3次誤啟情形。

這項技術最為特別的是,就算患者已完全無法發聲,也能夠訓練對應的AI語音模型。研究團隊今次是利用參與者中風前的聲音樣本,例如婚禮影片錄音,使系統產生的語音,可以高度還原她原本的聲線。此外,該系統還具備隱性語音啟動辨識能力,能即時識別用戶是否試圖「說話」。

在日常文句測試中,該系統的語音輸出詞錯誤率為12.3%,文字輸出詞錯誤率為10.3%。在廣泛語料測試中,兩者錯誤率分別增至58.8%與31.9%,但仍顯著優於過去延遲輸出的語音神經義體。除了這名參與者外,系統亦已應用於其他裝置或數據,包括另一位癱瘓者的大腦微電極,以及健康受試者的肌電圖上,顯示該技術有充足可擴展性。

支持EJ Tech

如欲投稿、報料,發布新聞稿或採訪通知,按這裏聯絡我們。

如欲投稿、報料,發布新聞稿或採訪通知,按這裏聯絡我們。