人工智能 難超越人 (占飛)

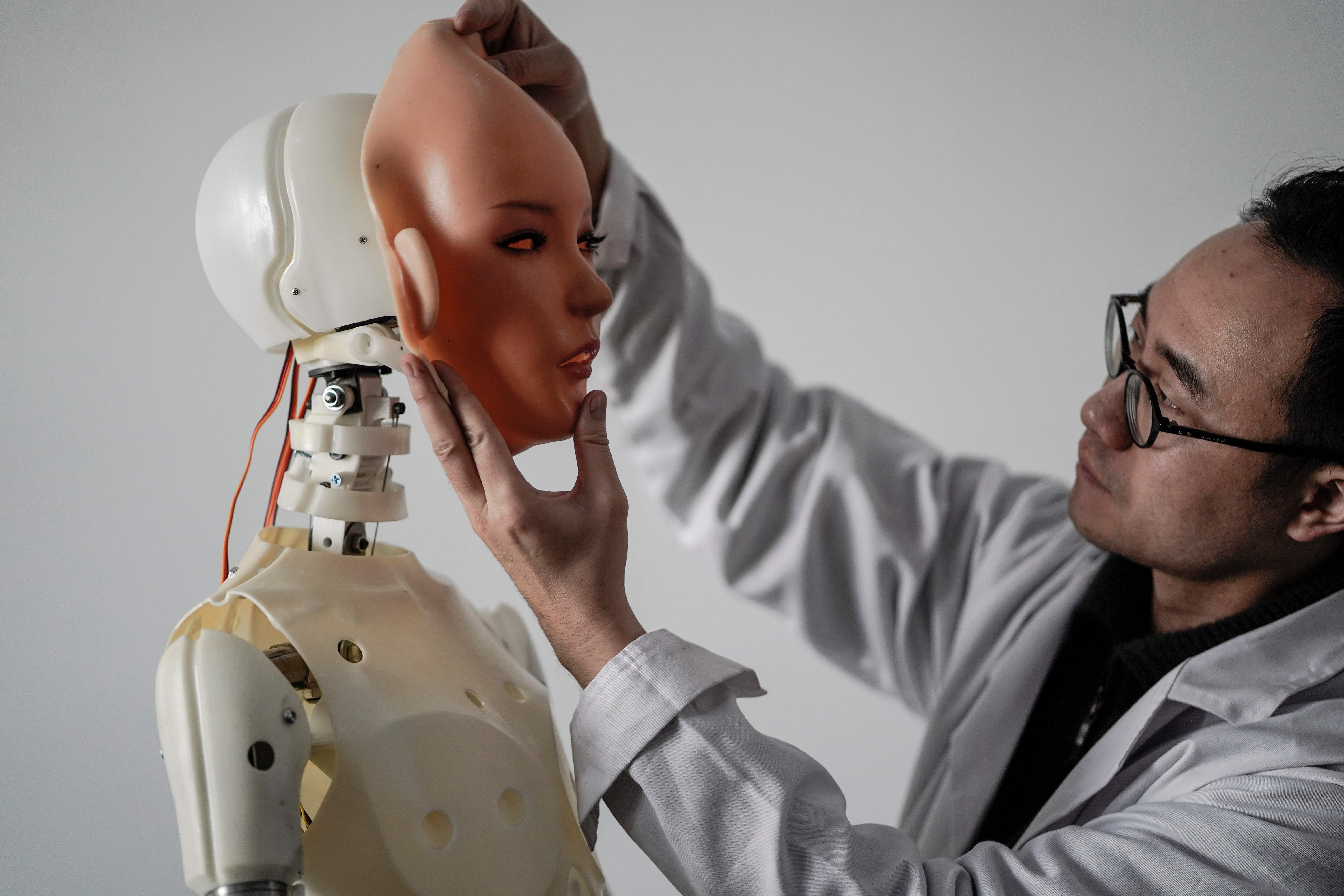

人有慾望和需要,因而人有目標,而這個目標還會因時而異。(法新社資料圖片)

自從AI(人工智能)面世以來,就有兩派意見。一派以霍金為首,認為AI終會超越人類,消滅人類。另一派則認為,AI既是人的受造物,縱使在許多方面比人類更出色,最終都無法超越人類。當AI能力愈來愈強,棋力遠勝人類,又識作曲、繪畫、寫詩、寫小說、談話等等,超越人類派更振振有詞了。

已故的美國科學家明斯基(Marvin Minsky)認為,終有一日AI會「進化」出思想意識。深度學習似乎證實了明斯基的預言。AlphaGo還要用人類棋譜學習下棋,AlphaGo Zero像周伯通般左、右手對弈3天,已天下無敵。可是,AlphaGo Zero學習的是「完全資訊博弈」遊戲,現實世界卻是「不完全資訊」。正如一些電腦科學家所言,現時深度學習需要大數據,比如要AI認識一物,分分鐘要給它看該物1500萬張影像,還可能會出錯。電腦科學家曾給AI看一張哈士奇(雪橇犬)的照片,AI竟誤認那是一頭狼。

沒有常識

人有常識(Common Sense),AI沒有。放一個蘋果在桌上,人憑常識已知道除非有人動它,否則蘋果會一直留在桌上。AI沒有這個常識,它不會作出這個判斷,除非你問AI,它才會憑牛頓力學的知識答你:蘋果會一直留在桌上。

醫學的AI會斷症,但那是經過深度學習大數據(Big Data)得來的「知識」:它可從X光片或磁力共振掃描中發現腫瘤,比人類更準確。可是,遇上奇難雜症(沒有大數據的病),AI可能束手無策。人腦無法駕馭大數據,但人類擅長憑小數據(Small Data)學習,甚至是「一次過學習」(One-shot Learning)。老經驗的偵探只須看過疑犯一眼便能認出。AI能嗎?又比如人看一張疑似尼斯湖水怪的照片,很快推斷這是否水怪,但沒有「真正」尼斯湖水怪大數據的AI能推斷出來嗎?AI最終能「一次過學習」嗎?目前,沒有電腦科學家敢保證AI能做得到。

現時,電腦科學家正教導AI如何小數據學習和「一次過學習」,問題是這需要人去標記數據,而這需要大量的人力及時間,屬於「高成本」學習,而且可能將人類的「認知偏差」(Cognitive Bias)誤置入AI裏。

AI擅長從大數據學習,優點是無「情」無「慾」,AI沒有愛,仍然可以做好工作。(網上圖片)

現任英國薩塞克斯大學(University of Sussex)認知科學研究教授的馬嘉烈寶頓(Margaret Boden),1972年已發表她第一篇AI論文,2016年還做過霍金的助手。她在今年6月劍橋大學的演講中指出:AI跟人類最大的分別是,人會關心(Care),AI不會。大多數醫生會關心病人。病人復元,醫生會感到滿足。醫不好,醫生會沮喪。AI呢?病人復元,AI完成任務,但不會高興和滿足。醫不好,AI亦不會沮喪。因為AI「事不關己,己不勞心」。正如馬嘉烈寶頓所言:對AI來說,nothing matters。

人會關心,因為人有慾望、有需要,AI只有人給它的目標。人有慾望和需要,因而人有目標,而這個目標還會因時而異。舉個例子,男子看到一個漂亮的女孩子在溜冰,為了追求她,他去學溜冰。當女孩子拒絕他的追求後,他已喜歡上溜冰。他繼續學習,以求有朝一日可以出席國際比賽爭獎牌,揚名聲顯父母及為港爭光。AI會像人類般轉移目標嗎?

無情無慾

說到人的需要和慾望,馬嘉烈寶頓引用美國心理學家馬斯勞(Abraham Maslow)的分法。人第一層需要是生存,跟住需要安全感、法律與秩序,第三層是愛與歸屬感,包括友誼、愛情、家庭、社區和國家。第四層的需要是自我肯定和別人的尊敬。第五層是自我實現(Self-Actualisation)。香港中學生都讀過這5個層次的需要。他們可能不知道,往後馬斯勞加上探險、美感和宗教等3層需要,合共8層。

終有一日,AI的認知和理性思維(Reasoning)能力可能遠勝人類,AI還可能有意識,甚至自我。可是,有了意識和自我的AI,會有馬斯勞筆下的8層需要嗎?也許AI需要生存和安全,但很難想像AI會需要愛、歸屬感、尊敬、美感和宗教等需要。為什麼這樣說?人類沒有愛,會哀傷痛苦,工作做不好。AI沒有愛,仍然可以做好工作。假如AI沒有愛,工作就做得不好,那人類幹嗎要創造AI呢?AI的優點就是無「情」、無「慾」,為什麼這樣的AI會威脅人類的生存呢?

馬嘉烈寶頓教授指出AI跟人類最大的分別是人會關心,AI不會。(網上圖片)

相片:網上圖片

撰文 : 占飛

更多占飛文章:

支持EJ Tech

如欲投稿、報料,發布新聞稿或採訪通知,按這裏聯絡我們。