Don't Miss

科技大突破|模型運算快逾十倍 Groq晶片挑機輝達

By 信報財經新聞 on February 22, 2024

原文刊於信報財經新聞「EJ Tech 創科鬥室」

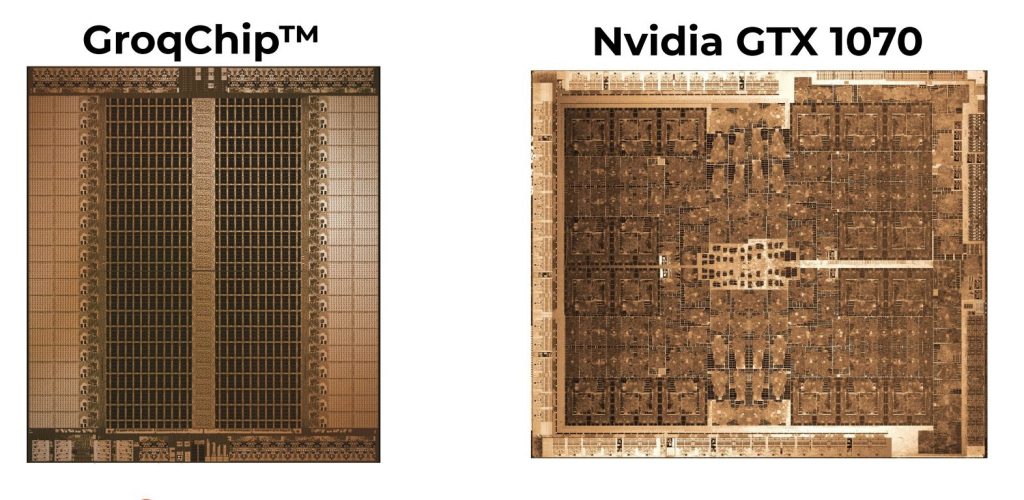

聊天機械人背後必須依賴晶片運算。美國人工智能(AI)晶片初創Groq最近聲名大噪,該企主打研發「語言處理單元」(LPU)晶片,當中採用張量流處理器(TPS)架構,克服計算量、記憶體頻寬兩大樽頸,聲稱其大型語言模型(LLM)的推理效能比頂級雲端供應商快18倍,足以挑戰輝達(Nvidia)圖像處理器(GPU)地位。

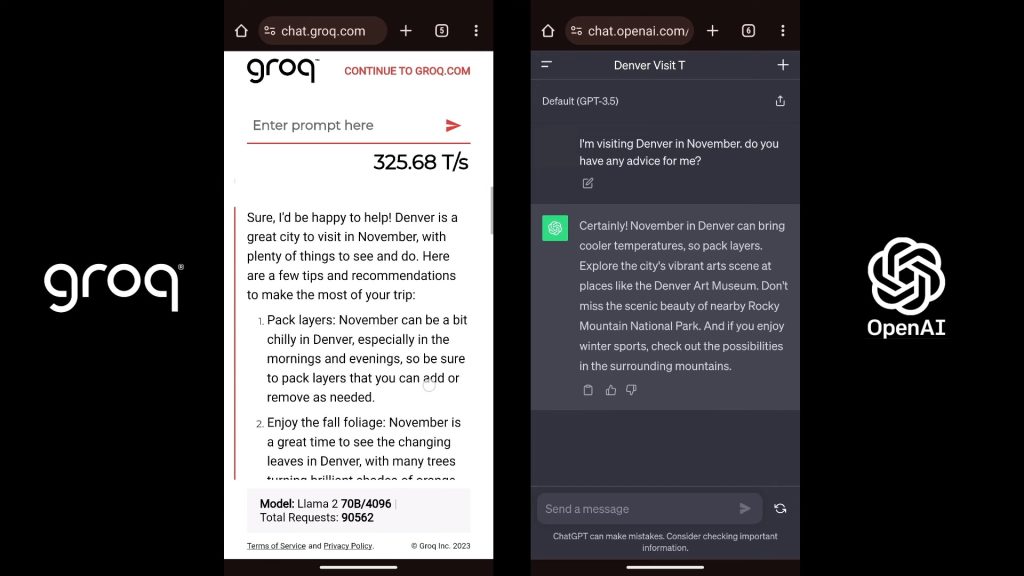

Groq網站最近公開API(應用程式介面)金鑰,並免費提供100萬Token(1個Token約等於英文4個字元),給已獲批准的會員試用10天。以執行Meta Llama2 7B模型為例,每秒可輸出750個Token,較OpenAI旗下GPT-3.5每秒40個Token快得多,價格為每100萬Token只需0.1美元,可說快如閃電且成本相宜。

微軟自研新網絡卡

據Artificial Analysis發布的第三方測試,Groq每秒產生247個Token,反觀微軟每秒僅18個Token,若ChatGPT在Groq的晶片上運行,其運行速度有望提高12倍以上。此外,The Information網站消息稱,微軟正開發一款新網絡卡,作為輝達網絡卡ConnectX-7替代品。

支持EJ Tech

如欲投稿、報料,發布新聞稿或採訪通知,按這裏聯絡我們。

如欲投稿、報料,發布新聞稿或採訪通知,按這裏聯絡我們。