平面變3D|World Labs平面照變3D互動場景「AI教母」開發大型世界模型

原文刊於信報財經新聞「EJ Tech 創科鬥室」

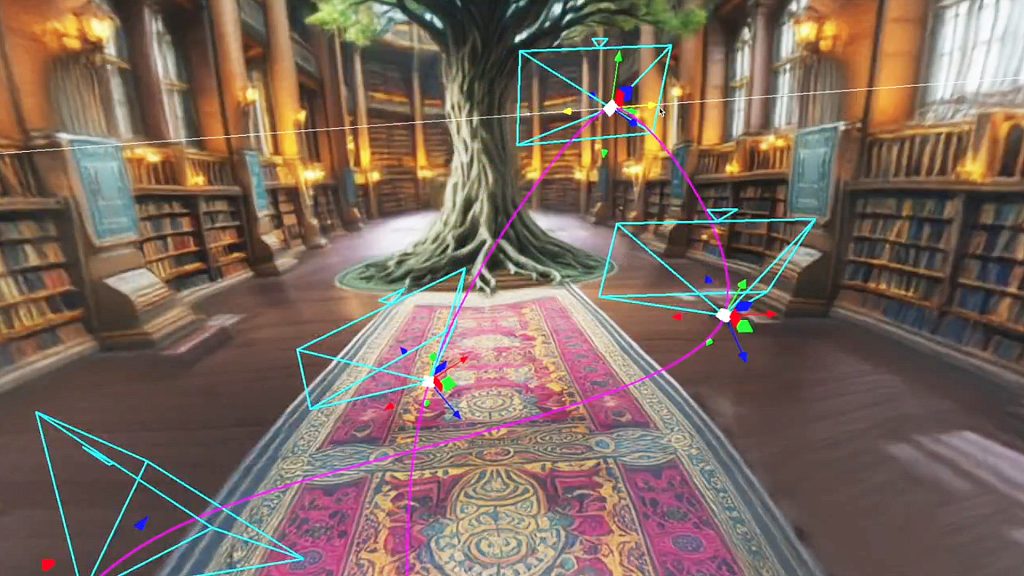

要創建一個沉浸式互動世界,需要多年時間開發及巨額預算。著名計算機科學家、有「人工智能(AI)教母」之稱的李飛飛,其創立的美國空間智能初創World Labs昨天發表首個專案。事前上傳一張AI生成的平面劇照,就能轉化為互動式3D場景,走進虛構世界並探索其中,勢將改變電影、電子遊戲、建築、虛擬教育的表現方式,為實現元宇宙又邁近一步。

目錄

改變電影建築表現方式

World Labs致力建立大型世界模型(Large World Models),AI技術可推算3D幾何的形狀,填充場景看不見的位置。系統會建立持久的3D環境,遵守基本的物理定律,即使把目光移開再回顧,效果亦不會突然改變。場景除了放大或縮小,更可應用即時相機效果,例如景深調整、移動變焦,亦可動態調整燈光變化、修改場景等,適應不同的藝術風格及場景。

示範影片可見,以荷蘭畫家梵高作品《夜晚露天咖啡座》為例,在3D空間投擲大量橙色籃球,球體會從牆身反彈回來。World Labs網站特設多個示範,用戶可透過網頁瀏覽器,以鍵盤滑鼠即時在場景散步,身歷其境觀看畫面細節。當然,目前版本不乏進步空間,例如場景無法完全探索,行動僅限於一個小區域。此外,偶爾出現渲染錯誤,物件以不自然方式混合一起。

World Labs今年4月成立,過去兩輪融資共獲2.3億美元(約17.94億港元),估值達10億美元的「獨角獸」規模。投資者陣容星光熠熠,包括矽谷風投a16z、輝達(Nvidia)創投部門NVentures、領英(LinkedIn)聯合創辦人霍夫曼(Reid Hoffman)、谷歌(Google)首席科學家迪恩(Jeff Dean)、谷歌前行政總裁施密特(Eric Schmidt)及AI教父辛頓(Geoffrey Hinton),還有Adobe、AMD和Salesforce等風投部門。

得州大學研聲音轉化街景

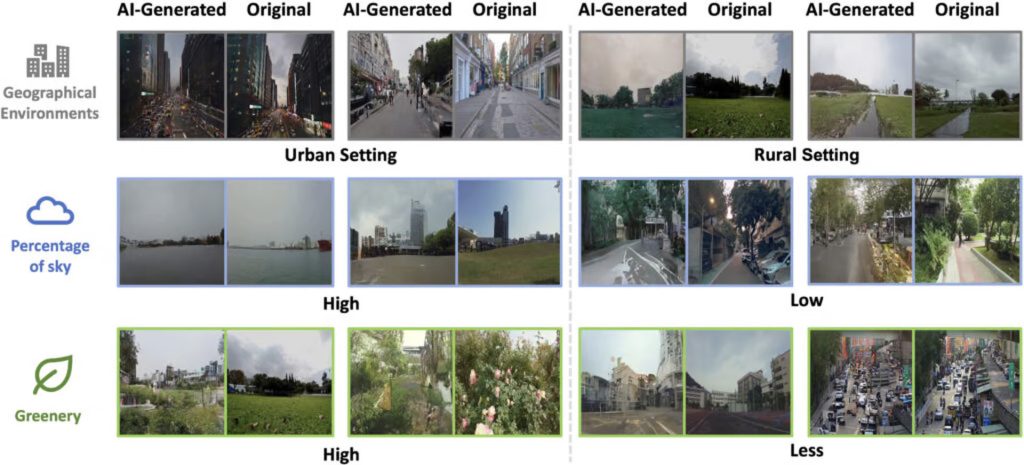

此外,美國得州大學奧斯汀分校的研究團隊,利用北美及歐亞地區的街道YouTube影片,以深度學習演算法訓練「聲景到影像擴散模型」,標榜能夠從錄音數據,以AI生成視覺化的街景圖像。而交通聲音、夜間昆蟲的鳴叫聲,可以揭示一天中的時間。AI生成的影像在許多情況下,亦反映來源短片的光照條件,例如晴天、陰天或晚間的天空。

現時谷歌、微軟、蘋果公司、Meta、高通等主要技術供應商,致力把空間運算引入各種邊緣設備,如智能手機、頭戴式顯示器、擴增實境(AR)眼鏡及機械人等。媒體顧問公司Omdia最新研究報告預計,全球空間運算市場規模,2024年將達到45億美元,並於2029年突破100億美元,年均複合增長率(CAGR)為18%。

支持EJ Tech

如欲投稿、報料,發布新聞稿或採訪通知,按這裏聯絡我們。

如欲投稿、報料,發布新聞稿或採訪通知,按這裏聯絡我們。