辨識真假AI: 挑戰與應對(吳壽冠)

本文作者吳壽冠先生(Ivan Ng),為數據素養協會資深創會會員兼Lively Impact創辦人及行政總裁,亦同時是心理學碩士及研究人員,為《EJTech》撰寫專欄。

隨著人工智慧技術的迅猛發展,特別是生成式人工智能(Generative AI)的突破,深偽技術(Deepfake)生成的虛假內容越來越精緻,真假難辨。這些新型的 AI 技術不僅能夠生成極為逼真的圖像和影片,還能通過圖靈測試,讓人難以分辨真偽,這對社會帶來了深遠的影響。

問題及案件頻發

深偽技術(Deepfake)的進步使得其在圖像、聲音、視頻方面被廣泛應用,造成的困擾日益凸顯,主要包括虛假信息散播、個人隱私侵犯、詐騙欺詐犯罪、政治操控、法律道德問題、信任危機、文化與社會影響等等問題。

其中有一些已經發生的案例特別突顯,引起各界關注:

假新聞傳播:社交媒體上假新聞的快速傳播可能導致公眾恐慌和社會不穩定,深偽技術(Deepfake)使得假新聞的製作變得更加容易。有報導指出, 香港人工智能深偽騙案在去年增加十倍。併隨著通訊技術的同步快速發展,假新聞的擴散迅速,不僅影響民眾的觀點和情緒,進一步影響公眾的認知,對社會信任和公共輿論造成負面影響,還可能造成社會動盪甚至對國家安全構成威脅。所以有媒體呼籲,全民應該提升媒體素養,齊齊打擊假內容。

金融欺詐:人臉辨識技術在金融領域的應用可能因Deepfake技術而受到威脅,偽造的人臉可能被用於身份盜竊或欺詐行為,對財務安全構成威脅。詐騙者發掘利用人臉識別技術,偽裝成他人进行金融诈骗。早前據香港警方指出,一家跨國公司的一名財務人員在視訊電話會議中被騙,詐騙者利用Deepfake 技術冒充該公司財務長,從而騙取這家企業2600 萬美元。

殺豬盤:這個是指透過社交平台或交友程式誘騙受害人投資股票、賭博的詐騙手法。這類事件伴隨著社交平台及網路轉賬的發展而出現,今年10月香港警方偵破的一個案件揭露出詐騙集團已經開始利用深偽技術進行詐騙。

假文憑面試:通過Deepfake技術偽造的文憑和證書可能變得更加難以識別,不僅會給招聘者在招聘過程中增加了辨認難度,甚至入學及入職流程都無法避免。而通過偽造的文憑進行升學及應聘,已經成為一種灰色產業。在香港發生的假學曆風暴,已經蔓延到澳門。

以上例子只是目前利用深偽技術進行詐騙的冰山一角。面對這些挑戰,如何有效地打擊假冒技術成為當前越變緊急的問題。以下我們將會探討一些辨認真假的方法。

辨認真假的方法及限制

對抗虛假信息的手段多種多樣,很多研究團隊及公司致力於開發「反Deepfake」的工具,化身AI 人工智能時代的「數位偵探」。目前已有多種辨識方法進行”打假”:

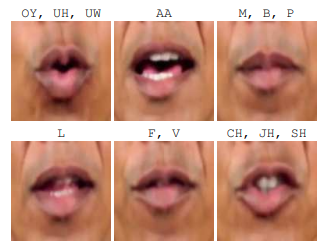

使用音位-視位不匹配的 Deepfake 檢測

這個檢測方法是由斯坦福大學和加州大學的聯合研究團隊開發,使用先進的人工智能算法來檢測 Deepfake 中視位(Viseme)和音位(Phoneme)之間是否一致。背後的依據是Deepfake 常犯的錯漏,Deepfake技術難將視頻嘴型動態與人物發音時口型完美匹配。該檢測方法將嘴巴的運動(發音嘴型)與口語單詞(音位)進行比較,並查找任何不匹配的地方。 如果檢測到不匹配,則會彈出強烈提示,該視頻可能為深度偽造。

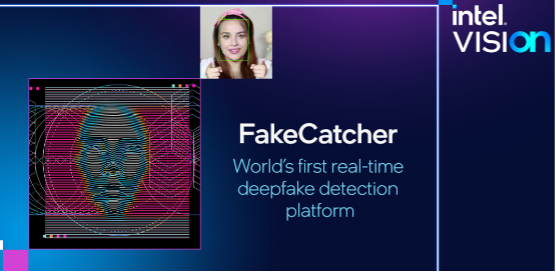

使用「血流」進行實時視頻Deepfake檢測

另外一個利用生理技術特征進行反深偽技術的是英特爾公司聯合紐約州立大學發明的 FakeCatcher實時深度造假檢測器。其背後的原理是利用人類心臟泵血時人類靜脈顏色會改變的事實,將這些收集到的數據通過算法及深度學習技術,轉換成時空圖鑒,作為視頻檢測的線索,檢測視頻的真假。這個微妙的「血流」Deepfake檢測技術能在毫秒之間達到96% 的準確率。

使用「混合邊界」進行Deepfake 檢測

動態視頻的反Deepfake方法較為多樣化,靜態照片的檢測亦有工具。微軟推出的驗證工具可以檢測靜態照片或視頻,提供實時置信度得分,其人工智能技術主要檢測深度偽造照片的細微灰度元素,比如頭髮絲與物體的混合邊界,與現實的圖片的參數是否差異,從而得出結論。

使用「多模型」進行Deepfake 檢測

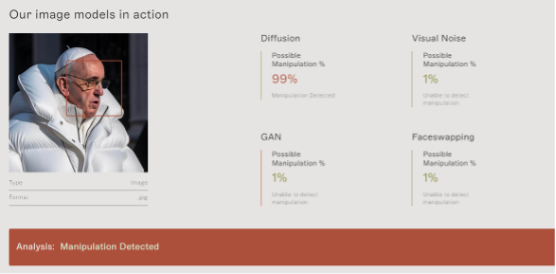

以上例子是利用人類難以模仿的生理特征進行真假辨認,但在反深偽技術中還有很多因素需要考慮,需要綜合各因素的權重才有一個偏向的檢測結論。Reality Defender 則採用了另一種模式,通過判斷各種Deepfake模型的生成方式,設計出對應的檢測模型, 採用“多模型”進行辨識,不再依賴單一的模型進行判斷。這些模型會進行非常細微的判斷,譬如生成的顏色處理方式、偽造的語音換氣頻率、聲紋處理等。

- 各方法的限制:

- 儘管上述辨識方法各有優勢,但仍然存在一些缺憾:

- 沒有一個工具達到100%的準確度。

- 反偽造技術需要不斷更新才能應對Deepfake技術的進步。

- 對於一般用戶而言,這些工具及方法有資金和技術門檻,不易普及。

- 查證的過程常常繁瑣且耗時,未必能在快速傳播的社交媒體環境中有效應對。

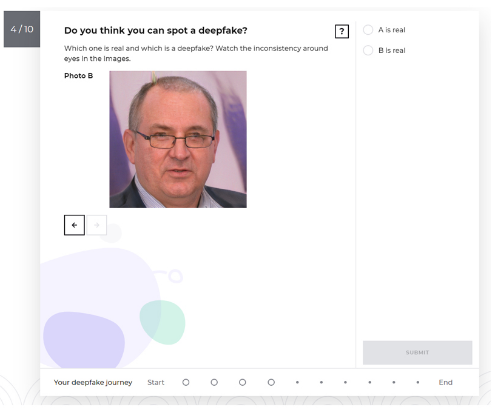

各界AI打假的實踐

雖然有這樣那樣的限制,各界仍然努力不斷投入資源進行AI打假。首先是業界和學界在人工智能大會上通過賽事鼓勵打假技術發展,推廣AI安全。再有學界進行媒體信息的篩查,譬如浸大成立的事實核查中心每日都會篩選社媒信息。而警方都有積極宣傳,將個人可採用的真假辨認方法推廣。我們個人則可以通過學習如何防範,謹防被騙。在必要的時候善用工具,對接觸到的內容進行甄別是否為AI 生成,還是真實信息。

綜上所述,雖然AI真假辨識變得越來越困難,但通過不斷技術革新和全球合作,未來的研究和實踐一定會更加注重技術的準確性和適應性,加強信息安全和真實性。我們仍有機會享用技術發展成果同時積極應對這一挑戰。

更多吳壽冠文章:

支持EJ Tech

如欲投稿、報料,發布新聞稿或採訪通知,按這裏聯絡我們。

如欲投稿、報料,發布新聞稿或採訪通知,按這裏聯絡我們。